AI协作缺的不是控制权,是预见力

一个月前,我在用Claude Code搭一个内容生产流水线。

中间有一步,Agent要决定用哪个文件夹结构来组织输出。它提议了一个方案,我看了看,觉得说得通,点了确认。

等整个流水线跑完,我才发现:那个命名方式,导致后面所有的汇总脚本全部找不到文件。返工了两个小时。

问题不是Agent做错了。问题是 我在那个决策时刻,完全不知道它的影响会蔓延多远 。

上周,新加坡国立大学发了一篇论文,让我终于能精确描述这个困境——以及它背后更大的产品问题。

*

控制权 ≠ 决策能力

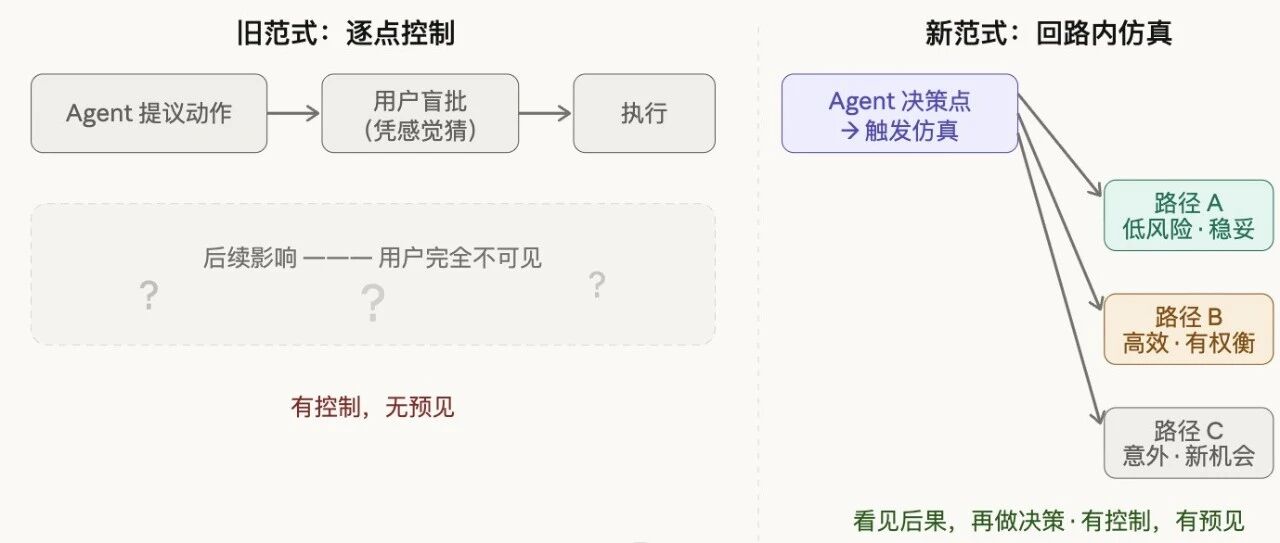

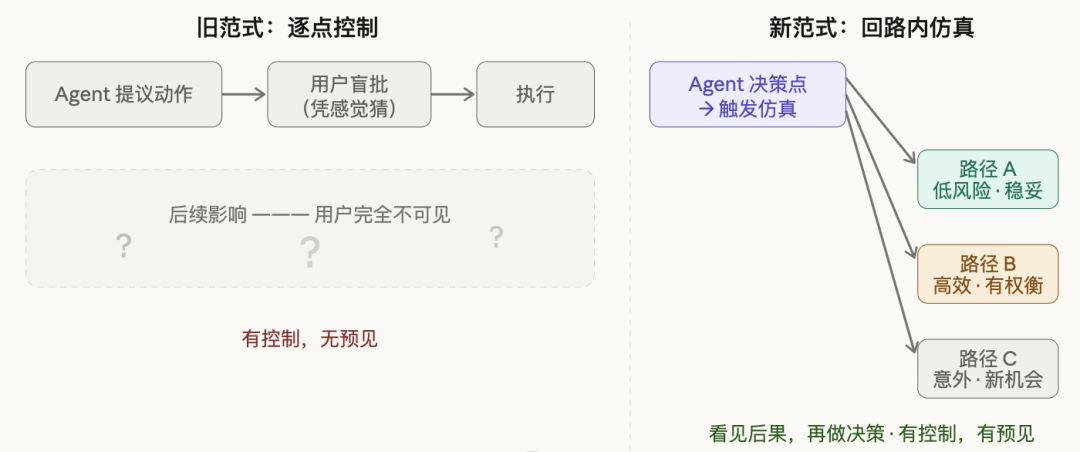

论文标题叫《从控制到预见》,核心诊断只有一句话:

当前的人机协作,给了用户控制权,但没给预见力。

现在主流的Agent交互是这样的:Agent执行到关键步骤,暂停,把下一个动作呈现给你,问:「这样做,行吗?」

你看了,觉得说得通,点了确认。

但你根本不知道这个决定会在第五步、第八步引发什么。论文指出,用户在这种交互里,被迫用脑子去「心智仿真」后续的连锁反应——而人类的心智仿真在多步骤任务面前,既慢又不准。我们的工作记忆根本不是为这种计算设计的。

所以表面上你在「审批」,实际上你在「猜」。

论文的比喻一针见血: 没有预见力的控制,就像开车没有前灯——你可以转方向盘,但你看不到前方的路。

回到我那个返工的故事:我不是不认真审批,我是根本没有能见度。

*

现在的AI产品界面,是给执行者设计的

这里有一个被长期忽视的事实。

过去几十年,人机交互的范式建立在一个前提上—— 人负责决策,机器负责执行 。所以界面只需要让人表达意图、确认结果就够了。

但Agent出现之后,这个前提翻转了: 机器在决策,人负责监督 。

然而界面没有跟着翻转。

我们现在拿着一套为「执行者」设计的交互界面,去完成「监督者」的工作。监督者需要的是上帝视角——能看见决策的后续影响,能比较不同路径的风险与权衡。

但我们给他们的,只是一个「批准 / 拒绝」按钮。

这不是用户不会用AI。这是产品设计的根本性错误。

*

新框架:让Agent把未来展示出来

论文的核心提案叫「回路内仿真」(simulation-in-the-loop)。

逻辑很简单:在Agent的每一个关键决策节点,不是直接提出「我要做A」,而是仿真出多条可能的未来路径,连同每条路径的风险、机遇、权衡、不确定性一起呈现——让用户在「看见后果」之后,再决定走哪条路。

这个框架改变了一件根本的事: 把「审批动作」升级为「选择未来」。

前者是被动响应,后者是主动决策。认知负担看似增加了,实际上反而减少了——因为你不再需要在脑子里猜,系统已经帮你算出来了。

论文还点出一个我认为更有价值的副产品: Serendipity(意外发现) 。

当Agent只呈现一条路径,用户批准了就继续走,根本不会想「有没有第四条路」。但当系统展示三条路径时,用户有时会说:「等等,路径C里有个细节让我意识到,我真正想要的其实是另一件事。」

这是隐藏需求的浮现。在「看见可能的未来」之前,有些偏好根本不知道自己有。仿真,创造了发现这些偏好的空间。

*

我的判断:谁先设计进产品,谁拿走制高点

具体来说,有三个方向值得现在就押注:

决策前的分支预览。 在Agent执行复杂任务的关键节点,自动生成2-3条可能路径及其模拟后果,而不是只呈现「推荐方案」。这不是成本,这是信任基础。

风险可视化,而不是风险文字。 「这个操作可能有风险」是没用的。有用的是:「如果你选A,第4步会出现这个约束;如果你选B,效率提升30%但第7步需要你手动介入一次。」

用仿真暴露隐藏需求。 这一点目前几乎没有产品在做。用户说不清楚自己要什么,但展示几条可能的结果之后,他们立刻就知道哪条是对的。这比任何需求澄清对话都更有效。

*

最后

「人机交互的终局是什么?」我一直在用「自然语言」回答这个问题。

这篇论文让我意识到,自然语言只解决了「表达」的问题,还没有解决「判断」的问题。

当AI越来越能干,人的角色从执行者变成了决策者。而决策者最缺的,不是更好的操作界面,是 判断所需的信息 。

下一代最好的AI产品,不会问你「要不要执行这一步」,而会问你: 「这三条路,你要走哪一条?」

然后把每条路的终点都给你看。

那个时候,我们今天用的「批准 / 拒绝」按钮,会显得像一个遗迹。

*

_ 参考:Gaole He & Brian Y. Lim,《From Control to Foresight: Simulation as a New Paradigm for Human-Agent Collaboration》,arXiv:2603.11677,新加坡国立大学,2026.3 _